Typische Fehler bei einer Entscheidungsmatrix – Eine Entscheidungsmatrix soll eigentlich Klarheit schaffen – in der Praxis sorgt sie aber erstaunlich oft für falsche Sicherheit. Kriterien werden „aus dem Bauch“ gewichtet, Skalen inkonsistent genutzt, Teamdynamiken verzerren das Ergebnis. Das führt zu Entscheidungen, die zwar gut begründet aussehen, aber auf wackliger Grundlage stehen.

In diesem Beitrag zeige ich, welche typischen Fehler bei einer Entscheidungsmatrix auftreten, warum sie gefährlich sind und wie Sie sie konsequent vermeiden. Mit praxisnahen Beispielen, klaren Leitplanken und einer Schritt-für-Schritt-Checkliste, die Sie direkt im Projekt-, Strategie- oder Investitionskontext anwenden können.

1. Kurz erklärt: Was ist eine Entscheidungsmatrix?

Eine Entscheidungsmatrix ist ein tabellarisches Hilfsmittel, mit dem verschiedene Optionen anhand definierter Kriterien systematisch bewertet und miteinander verglichen werden.

Kernelemente einer Entscheidungsmatrix:

- Zeilen: Handlungsalternativen (z. B. Software A, B, C)

- Spalten: Bewertungskriterien (z. B. Kosten, Nutzen, Risiko, Umsetzungsaufwand)

- Skala: Bewertungsmaßstab (z. B. 1–5 oder 1–10)

- Optional: Gewichtung der Kriterien (z. B. „Kosten“ 30 %, „Nutzen“ 40 %, „Risiko“ 30 %)

- Ergebnis: Summen- oder Nutzwert je Alternative, Rangfolge und begründete Empfehlung

Sie ist eng verwandt mit Methoden wie Nutzwertanalyse, Punktbewertung oder Scoring-Modell – unterscheidet sich aber je nach Ausprägung in Detailgrad und Formalisierung.

2. Warum Entscheidungsmatrizen im Alltag scheitern

Auf dem Papier wirkt die Methode bestechend logisch. In der Realität scheitert sie oft an denselben Punkten:

- Die falschen (oder zu viele) Kriterien

- Unsaubere Definition und Gewichtung

- Subjektive Bewertungen ohne Korrektiv

- „Kosmetik“ am Ergebnis, bis es politisch passt

- Fehlende Dokumentation der Annahmen

Das Problem ist selten die Methode selbst, sondern ihre Anwendung. Typische Fehler bei einer Entscheidungsmatrix zu kennen, ist daher entscheidend, um sie als seriöses Management-Werkzeug zu nutzen – statt als Feigenblatt für längst getroffene Entscheidungen.

3. Überblick: Die häufigsten Fehler bei einer Entscheidungsmatrix

Häufige Fehlerquellen auf einen Blick:

- Unklare Zielsetzung und Entscheidungssituation

- Falsche oder unvollständige Kriterien

- Zu viele Kriterien („Everything but the kitchen sink“)

- Willkürliche oder inkonsistente Gewichtung

- Intransparente oder uneinheitliche Bewertungsskalen

- Vermischung von Fakten und Meinungen

- Groupthink, Dominanz einzelner Personen

- Nachträgliche Anpassung von Gewichten („Ergebnis zurechtbiegen“)

- Keine Sensitivitätsanalyse („Was-wäre-wenn?“ bleibt ungeprüft)

- Fehlende Dokumentation und Nachvollziehbarkeit

- Ignorieren von Unsicherheiten und Risiken

- Verwechslung von Genauigkeit mit „Wahrheit“

- Überdimensionierter Aufwand für triviale Entscheidungen

Im Folgenden gehen wir diese Punkte systematisch durch – jeweils mit Praxisbezug und konkreten Gegenmaßnahmen.

4. Fehler 1: Unklare Zielsetzung und Entscheidungssituation

Typischer Fehler: Die Entscheidungsmatrix wird gebaut, bevor klar ist, welche Entscheidung überhaupt getroffen werden soll und wofür die Matrix dienen soll (Exploration, Vorauswahl, finale Entscheidung, Kommunikationsgrundlage?).

Symptome

- Die Frage lautet nur „Welche Option ist die beste?“ – ohne Kontext

- Beteiligte haben unterschiedliche Bilder im Kopf (z. B. kurzfristige vs. langfristige Optimierung)

- Mitten im Prozess werden Ziele umdefiniert („Ach so, Kosten sind doch entscheidend“)

Folgen

- Kriterien sind nicht sauber an strategische Ziele gekoppelt

- Die Matrix unterstützt zwar eine Entscheidung, aber nicht unbedingt die richtige Entscheidung

Besser machen

Vor der ersten Zeile in Excel sollten Sie folgende Fragen schriftlich klären:

- Welches Problem lösen wir konkret?

- Welche Entscheidung führt die Matrix herbei? (z. B. Tool-Auswahl, Anbieter-Shortlist, Standortentscheidung)

- Welche Ziele überwiegen? Wachstum, Risiko-Minimierung, Kosten, Flexibilität, Time-to-Market?

- Reicht eine Vorauswahl oder soll die Matrix die finale Entscheidung stützen?

Erst dann definieren Sie Kriterien und Design der Matrix.

5. Fehler 2: Falsche oder unvollständige Kriterien

Typischer Fehler: Es werden vor allem die Kriterien aufgenommen, die spontan einfallen oder leicht messbar sind – strategisch wichtige, aber schwerer greifbare Aspekte fehlen.

Beispiele

- Tool-Auswahl nur nach Lizenzkosten und Funktionsumfang – aber ohne „Integrationsfähigkeit“, „Akzeptanz im Fachbereich“, „Vendor-Lock-in“

- Standortentscheidung nur nach Miete und Flächen – ohne „Fachkräfteverfügbarkeit“ oder „Rekrutierungspotenzial“

Folgen

- Scheinpräzise Bewertung mit „blinden Flecken“

- Entscheidung wird in der Praxis später von nicht berücksichtigten Faktoren dominiert

Besser machen

- Kriterien nicht allein im Projektteam definieren, sondern relevante Stakeholder einbeziehen

- Leitfrage: „Welche Aspekte entscheiden in 12–24 Monaten darüber, ob diese Entscheidung als Erfolg gilt?“

- Kriterien grob clustern:

- Wirtschaftlichkeit (Capex/Opex, TCO)

- Nutzen/Mehrwert

- Risiko & Compliance

- Organisation & Change

- Technik & Architektur

- Pro Cluster nur die wichtigsten 2–3 Kriterien zulassen

6. Fehler 3: Zu viele Kriterien

Typischer Fehler: Jede Fachabteilung bringt „ihr“ Kriterium ein, nichts wird gestrichen. Am Ende umfasst die Matrix 20–30 Kriterien.

Symptome

- Übersicht geht verloren

- Gewichtung wird beliebig

- Diskussionen drehen sich um Details ohne Relevanz für das Gesamtergebnis

Folgen

- Einzelne Kriterien haben faktisch kaum Einfluss

- Auswertung wird komplex, ohne zusätzlichen Erkenntnisgewinn

Besser machen

- Radikale Priorisierung: Maximal 7–10 Kriterien

- „Nice-to-have“-Kriterien konsequent zu einem Sammelkriterium zusammenfassen oder streichen

- Hilfreiche Frage: „Würde sich unsere Entscheidung ändern, wenn dieses Kriterium wegfällt?“ – Wenn nein, streichen.

7. Fehler 4: Willkürliche oder inkonsistente Gewichtung

Typischer Fehler: Gewichte werden „aus dem Bauch heraus“ vergeben (z. B. Kosten 30 %, Nutzen 40 %, Risiko 30 %), weil es „irgendwie plausibel“ klingt – ohne methodische Herleitung.

Typische Probleme

- Gewichtungen spiegeln persönliche Präferenzen, nicht Unternehmensziele

- Mitglieder des Gremiums verstehen die Konsequenzen der Gewichtung nicht

- Im Verlauf des Projekts werden Gewichtungen stillschweigend verschoben

Folgen

- Ergebnis der Entscheidungsmatrix ist stark von Annahmen abhängig

- Schon kleine Änderungen in der Gewichtung kippen die Rangfolge (ohne dass dies bewusst ist)

Besser machen

- Gewichtung immer gemeinsam und explizit vornehmen

- Kurze, strukturierte Vorgehensweisen nutzen:

- Paarweiser Vergleich (AHP light): Kriterien paarweise vergleichen („Was ist wichtiger – Kosten oder Nutzen?“) und daraus Gewichte ableiten

- Budgetansatz: 100 Punkte auf Kriterien verteilen und im Team diskutieren

- Sensitivitätsanalyse durchführen: „Wie stabil ist das Ergebnis, wenn ich ein Kriterium um ±10 % ändere?“

8. Fehler 5: Unklare Bewertungsskala

Typischer Fehler: Es wird zwar eine Skala (z. B. 1–5) verwendet, diese ist aber nicht definiert. Jeder bewertet „nach Gefühl“.

Symptome

- Eine 4 bei Person A bedeutet „gut“, bei Person B schon „sehr gut“

- Kriterien mit völlig unterschiedlichen Spannweiten (z. B. Kostenunterschiede im sechsstelligen Bereich vs. leichte UX-Unterschiede) werden mit derselben Skala bewertet, ohne Normalisierung

Folgen

- Scores sind nicht vergleichbar

- Diskussionen drehen sich um Einzelfälle („Warum hat Option B hier eine 3 und nicht 4?“)

Besser machen

- Skala explizit definieren, z. B.:

- 1 = erfüllt Anforderung nicht

- 2 = erfüllt Anforderung eingeschränkt

- 3 = erfüllt Anforderung ausreichend

- 4 = erfüllt Anforderung gut

- 5 = erfüllt Anforderung sehr gut / übertrifft Anforderungen

- Für kritische Kriterien Beispielanker formulieren

- Bei stark quantitativen Kriterien (z. B. Kosten) Werte vorher normieren (z. B. beste Option = 5, schlechteste = 1, dazwischen linear oder schrittweise)

9. Fehler 6: Vermischung von Fakten und Meinungen

Typischer Fehler: Objektive Daten (z. B. Lizenzpreise, SLA) werden in der gleichen Logik bewertet wie subjektive Eindrücke (z. B. „Sympathie für den Anbieter“), ohne Kennzeichnung.

Beispiele

- „Zukunftssicherheit“ wird mit 5 bewertet, weil der Anbieter „einen guten Eindruck“ gemacht hat

- „Benutzerfreundlichkeit“ basiert auf dem Eindruck von 2 Personen, nicht auf einem strukturierten Test

Folgen

- Pseudo-Objektivität: Der Eindruck einer Person wird in eine Zahl gegossen und mit harten Fakten verrechnet

- Schwer nachvollziehbar für Außenstehende

Besser machen

- Klare Trennung:

- Faktische Kriterien: mit belastbaren Daten hinterlegen (Angebote, Verträge, Kennzahlen)

- Subjektive Kriterien: klar als solche kennzeichnen und idealerweise breiter absichern (z. B. Usability-Test mit mehreren Nutzern)

- Bewertungsvermerk pro Kriterium: „Datenbasis: Angebot vom … / Testworkshop am … / Experteneinschätzung von …“

10. Fehler 7: Groupthink und Dominanz einzelner Personen

Typischer Fehler: In Workshops dominieren lautstarke Stimmen oder Hierarchieträger die Bewertung; kritische Meinungen kommen nicht zum Zug.

Symptome

- Wenige Personen sprechen, andere nicken nur

- Vorschläge des Top-Managements werden kaum hinterfragt

- Am Ende fühlt es sich an wie eine Bestätigung einer ohnehin gewünschten Lösung

Folgen

- Matrix-Ergebnis spiegelt nicht die Expertise im Raum wider

- Potenzielle Risiken werden nicht ausreichend beleuchtet

Besser machen

- Bewertungsrunde zunächst anonym (z. B. per Online-Formular oder digitalem Board)

- Erst danach gemeinsame Diskussion von Abweichungen

- Moderator einsetzen, der Hierarchieeinflüsse aktiv adressiert („Wir bewerten hier fachlich, nicht politisch.“)

11. Fehler 8: Ergebnis-Frisieren durch nachträgliche Anpassungen

Typischer Fehler: Nachdem ein (unerwünschtes) Ergebnis vorliegt, werden still die Kriterien, Gewichte oder Bewertungen angepasst, bis die „richtige“ Option vorne liegt.

Symptome

- „Vielleicht ist dieses Kriterium doch weniger wichtig…“

- „Diese Bewertung ist vielleicht zu streng gewesen…“

- Mehrere Iterationen, bis das vertraute Tool oder der bevorzugte Standort vorne liegt

Folgen

- Verlust an Glaubwürdigkeit und Akzeptanz

- Die Entscheidungsmatrix wird zum Feigenblatt statt zum Entscheidungswerkzeug

Besser machen

- Vor Beginn festlegen:

- Kriterien

- Gewichtungslogik

- Bewertungsregeln

- Änderungen nur:

- vor der ersten Bewertung oder

- nach einem klar dokumentierten Review („Wir haben gemerkt, dass Kriterium X doppelt vorkommt, daher Anpassung…“)

- Änderungen transparent protokollieren

12. Fehler 9: Keine Sensitivitätsanalyse

Typischer Fehler: Das Endergebnis wird als „gegeben“ akzeptiert, ohne zu prüfen, wie stabil es gegenüber Änderungen der Annahmen ist.

Wichtige Fragen, die oft fehlen

- „Was passiert, wenn Kosten 10 % schwerer wiegen?“

- „Wenn ein Kriterium komplett entfällt – ändert sich die Rangfolge?“

- „Wie robust bleibt die Entscheidung, wenn wir bei einem Kriterium in der Bewertung danebenliegen?“

Folgen

- Schein-sichere Entscheidung, die in Wirklichkeit sehr fragil ist

- Überraschung, wenn sich Rahmenbedingungen leicht ändern

Besser machen

- Einfache Sensitivitätschecks:

- Gewichte einzelner Kriterien um ±10–20 % anpassen

- Extremfall-Szenarien (Kosten oder Risiko dominanter gewichten)

- Kritische Bewertungen einen Punkt nach oben/unten variieren

- Wenn sich die Rangfolge schon bei kleinen Änderungen dreht:

- Entscheidung als „knapp“ kennzeichnen

- Ergänzende Entscheidungsgrundlagen heranziehen (z. B. Pilot, Proof of Concept)

13. Fehler 10: Fehlende Dokumentation

Typischer Fehler: Nur die finale Tabelle wird archiviert, nicht aber die zugrunde liegenden Annahmen und Diskussionen.

Folgen

- In 12 Monaten weiß niemand mehr, warum genau so gewichtet wurde

- Revisionssicherheit und Lernfähigkeit fehlen („Was haben wir aus früheren Entscheidungen gelernt?“)

Besser machen

- Zu jeder Entscheidungsmatrix ein kurzes „Decision Log“ führen:

- Ziel der Entscheidung

- Beteiligte

- Kriterienliste mit Begründung

- Gewichtung mit Herleitung

- Kurzprotokoll zentraler Diskussionen und Annahmen

- Ablegen im Projekt- oder Qualitätsmanagement-System, nicht nur bei einzelnen Personen

14. Fehler 11: Ignorieren von Unsicherheiten und Risiken

Typischer Fehler: Es wird nur der „Best Guess“ bewertet, Unsicherheiten fließen nicht explizit ein.

Beispiele

- Kosten werden als fixer Wert angenommen, obwohl Angebote nur grobe Richtwerte sind

- Projektrisiken wie Abhängigkeit von einem Dienstleister werden nicht separat bewertet

Folgen

- Entscheidungen wirken stabiler, als sie sind

- Risikogesichtspunkte werden im Nachgang „ad hoc“ diskutiert, statt strukturiert eingebunden zu sein

Besser machen

- Unsicherheit und Risiko als eigene Kriterien aufnehmen:

- z. B. „Planungsunsicherheit“, „Implementierungsrisiko“, „Abhängigkeit von Einzelperson/Anbieter“

- Szenarien verwenden:

- Best Case, Realistic Case, Worst Case

- Wenn möglich: Wahrscheinlichkeit und Auswirkung bewerten (Risiko-Matrix verknüpfen)

15. Fehler 12: Verwechslung von Genauigkeit mit Wahrheit

Typischer Fehler: Weil alle Kriterien mit Zahlen hinterlegt sind, entsteht der Eindruck einer sehr exakten, objektiven Entscheidung.

Realität

- Viele Bewertungen bleiben trotz Skala und Definition subjektiv

- Gewichtungen sind Annahmen – wenn auch möglichst gut begründete

Besser machen

- Die Entscheidungsmatrix als Entscheidungsunterstützung, nicht als automatischen Entscheider begreifen

- Das Ergebnis immer im Kontext interpretieren:

- Wie deutlich ist der Abstand zwischen Option 1 und 2?

- Gibt es „Dealbreaker“, die sich nicht sauber in Zahlen abbilden lassen (Compliance, Kultur, strategische Partnerschaften)?

16. Fehler 13: Überdimensionierter Aufwand für triviale Entscheidungen

Typischer Fehler: Für kleine, wenig risikobehaftete Entscheidungen wird ein erheblicher Aufwand mit Matrizen, Workshops und Excel-Basteleien betrieben.

Folgen

- Frust im Team („Wegen so etwas machen wir jetzt eine Matrix?“)

- Verlust der Akzeptanz für die Methode bei wirklich wichtigen Entscheidungen

Besser machen

- Faustregel einführen: Entscheidungsmatrix nur, wenn mindestens eines zutrifft:

- hohe wirtschaftliche Relevanz

- langfristige Bindung (z. B. Plattformwechsel)

- hoher Einfluss auf viele Stakeholder

- relevante Risiken

- Für kleinere Themen einfache Pro-&-Contra-Listen oder kurze Scorings verwenden

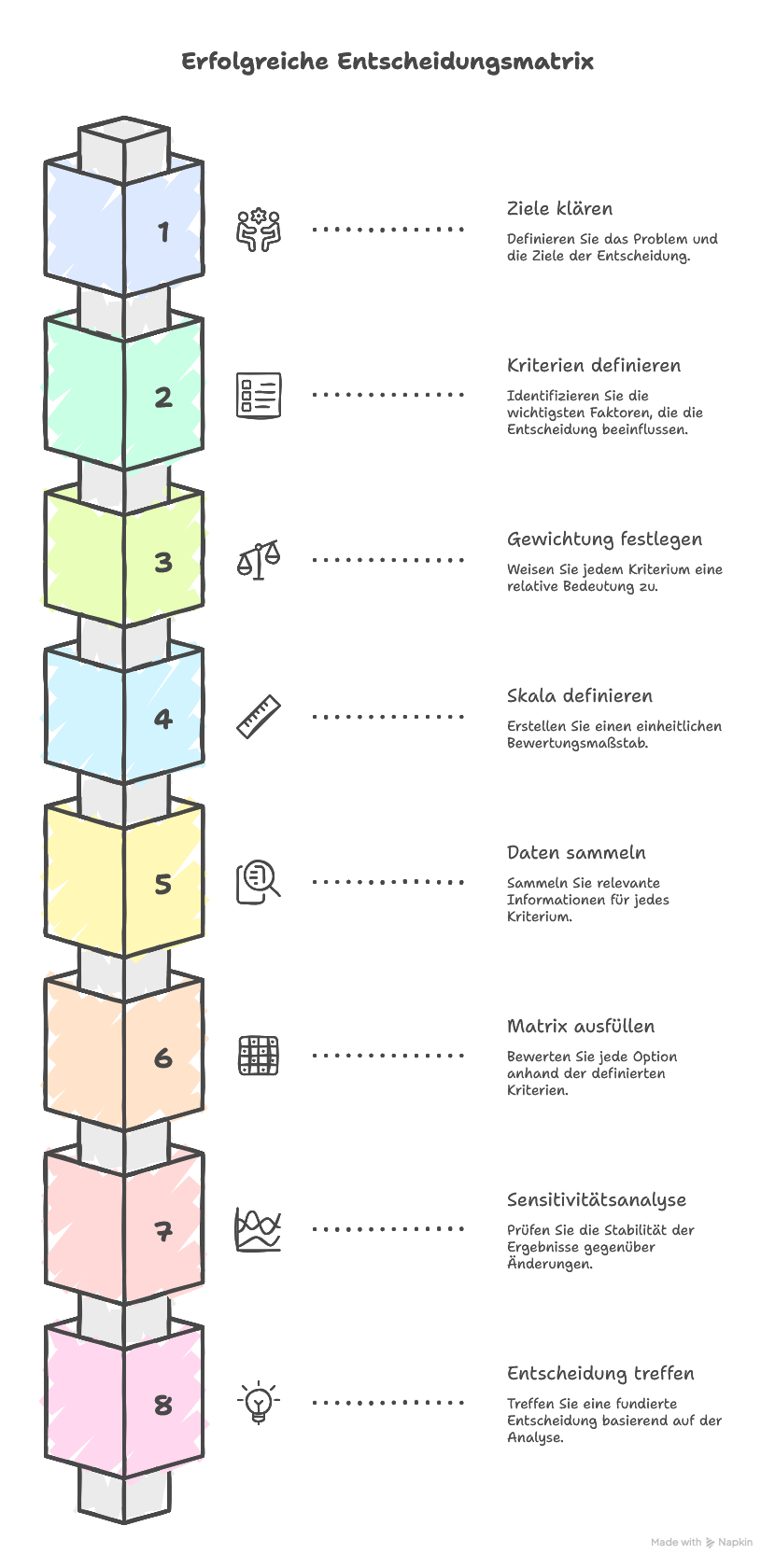

17. Praxisleitfaden: So setzen Sie eine Entscheidungsmatrix richtig auf

Um typische Fehler bei einer Entscheidungsmatrix systematisch zu vermeiden, hilft ein klarer Ablauf.

Entscheidung und Ziele klären

- Was wird entschieden?

- Welche Unternehmensziele sind betroffen?

- Wer entscheidet letztlich, wer berät?

Kriterien definieren und priorisieren

- Brainstorming mit Stakeholdern

- Clustern und konsolidieren

- Auf 7–10 Kernkriterien reduzieren

Gewichtung strukturiert festlegen

- 100-Punkte-Verteilung oder Paarvergleich

- Ergebnis dokumentieren und im Kreis der Entscheider freigeben

Bewertungsskala definieren

- Einheitliche Skala mit klaren Bedeutungen (z. B. 1–5)

- Beispielanker für kritische Kriterien

Datenbasis und Bewertungsverfahren festlegen

- Welche Quellen werden genutzt (Angebote, Referenzen, Tests)?

- Wer bewertet welches Kriterium?

- Werden Mittelwerte aus mehreren Bewertungen gebildet?

Matrix ausfüllen – zuerst individuell, dann im Plenum

- Einzelbewertungen einsammeln

- Abweichungen und Ausreißer diskutieren

- Konsens oder dokumentierte Mehrheitsmeinung festhalten

Sensitivitätsanalyse durchführen

- Gewichte und kritische Bewertungen variieren

- Stabilität der Rangfolge prüfen

- Ggf. Matrix für Szenarien duplizieren (Kostenfokus vs. Nutzenfokus)

Entscheidung treffen und dokumentieren

- Matrixergebnis plus qualitative Erwägungen zusammenführen

- Entscheidung und Begründung transparent machen

- Lessons Learned für nächste Entscheidungen notieren

18. Checkliste: Typische Fehler bei einer Entscheidungsmatrix vermeiden

Diese kompakte Liste können Sie vor Einsatz jeder Matrix durchgehen:

- Entscheidung und Zielbild schriftlich definiert?

- Kriterien auf 7–10 wesentliche Punkte reduziert?

- Kriterien logisch mit den Unternehmenszielen verknüpft?

- Gewichtungen methodisch hergeleitet und dokumentiert?

- Bewertungsskala einheitlich definiert (mit Beispielen)?

- Fakten und Meinungen sauber getrennt und gekennzeichnet?

- Bewertungsprozess gegen Groupthink abgesichert (z. B. anonyme Erstbewertung)?

- Keine nachträgliche „Ergebnis-Kosmetik“ ohne Dokumentation?

- Sensitivitätsanalyse durchgeführt und Ergebnisrobustheit geprüft?

- Alle Annahmen, Datenquellen und Diskussionen dokumentiert?

Wenn Sie die meisten dieser Fragen ehrlich mit „Ja“ beantworten können, sind Sie den typischen Fehlern bereits einen großen Schritt voraus.

19. Fazit: Entscheidungsmatrix als starkes, aber kein unfehlbares Werkzeug

Eine Entscheidungsmatrix ist ein mächtiges Instrument, um komplexe Entscheidungen zu strukturieren, Transparenz zu schaffen und Diskussionen zu versachlichen.

Sie wird allerdings nur dann ihrer Rolle gerecht, wenn:

- die richtigen Kriterien gewählt werden,

- Gewichtungen nicht aus dem Bauch entstehen,

- Bewertungen auf belastbaren Grundlagen beruhen,

- Unsicherheit und Risiko explizit berücksichtigt werden und

- der Prozess offen und dokumentiert gestaltet ist.

Nutzen Sie die Matrix als das, was sie ist: ein Werkzeug, das Denken strukturiert – kein Automat, der Ihnen das Denken abnimmt.

Wenn Sie vor einer wichtigen Investitions-, Strategie- oder Tool-Entscheidung stehen und sicherstellen möchten, dass Ihre Entscheidungsmatrix fachlich sauber aufgesetzt ist, lohnt sich ein externer Blick. Ein erfahrener Sparringspartner wie PURE Consultant kann dabei helfen, Kriterien, Gewichtung und Vorgehen so zu gestalten, dass Ihre Entscheidung sowohl intern tragfähig als auch methodisch belastbar ist.